Esta semana, China decidió no firmar un “plan” internacional acordado por unas 60 naciones, incluido Estados Unidos, que buscaba establecer barreras de seguridad al emplear inteligencia artificial (IA) para uso militar.

Más de 90 naciones asistieron a la cumbre sobre Inteligencia Artificial Responsable en el Dominio Militar (REAIM) celebrada en Corea del Sur el lunes y martes, aunque aproximadamente un tercio de los asistentes no apoyaron la propuesta no vinculante.

El experto en IA Arthur Herman, miembro principal y director de la Iniciativa de Alianza Cuántica del Instituto Hudson, dijo a Fox News Digital que el hecho de que unas 30 naciones hayan optado por no participar en este importante avance en la carrera por desarrollar la IA no es necesariamente motivo de preocupación, aunque en El caso de Beijing probablemente se deba a su oposición general a la firma de acuerdos multilaterales.

Se muestra a los participantes antes de la sesión de clausura de la cumbre de REAIM en Seúl, Corea del Sur, el 10 de septiembre de 2024. (JUNG YEON-JE/AFP vía Getty Images)

AL DOMINAR ‘EL ARTE DEL LAVADO DE CEREBRO’, CHINA INTENSIFICA LA CENSURA DE LA IA

“Lo que se reduce a… es que China siempre desconfía de cualquier tipo de acuerdo internacional en el que no haya sido el arquitecto o no haya participado en la creación y organización de cómo se va a configurar e implementar ese acuerdo”, dijo. “Creo que los chinos ven todos estos esfuerzos, todos estos esfuerzos multilaterales, como formas de tratar de restringir y limitar la capacidad de China de utilizar la IA para mejorar su ventaja militar”.

Herman explicó que la cumbre, y el plan acordado por unas cinco docenas de naciones, es un intento de salvaguardar la tecnología en expansión que rodea a la IA garantizando que siempre haya un “control humano” sobre los sistemas implementados, particularmente en lo que se relaciona con el ámbito militar y de defensa. asuntos.

“Los algoritmos que impulsan los sistemas de defensa y de armas dependen en gran medida de qué tan rápido pueden ir”, dijo. “[They] muévase rápidamente para recopilar información y datos que luego podrá regresar rápidamente al comando y control para que luego puedan tomar la decisión.

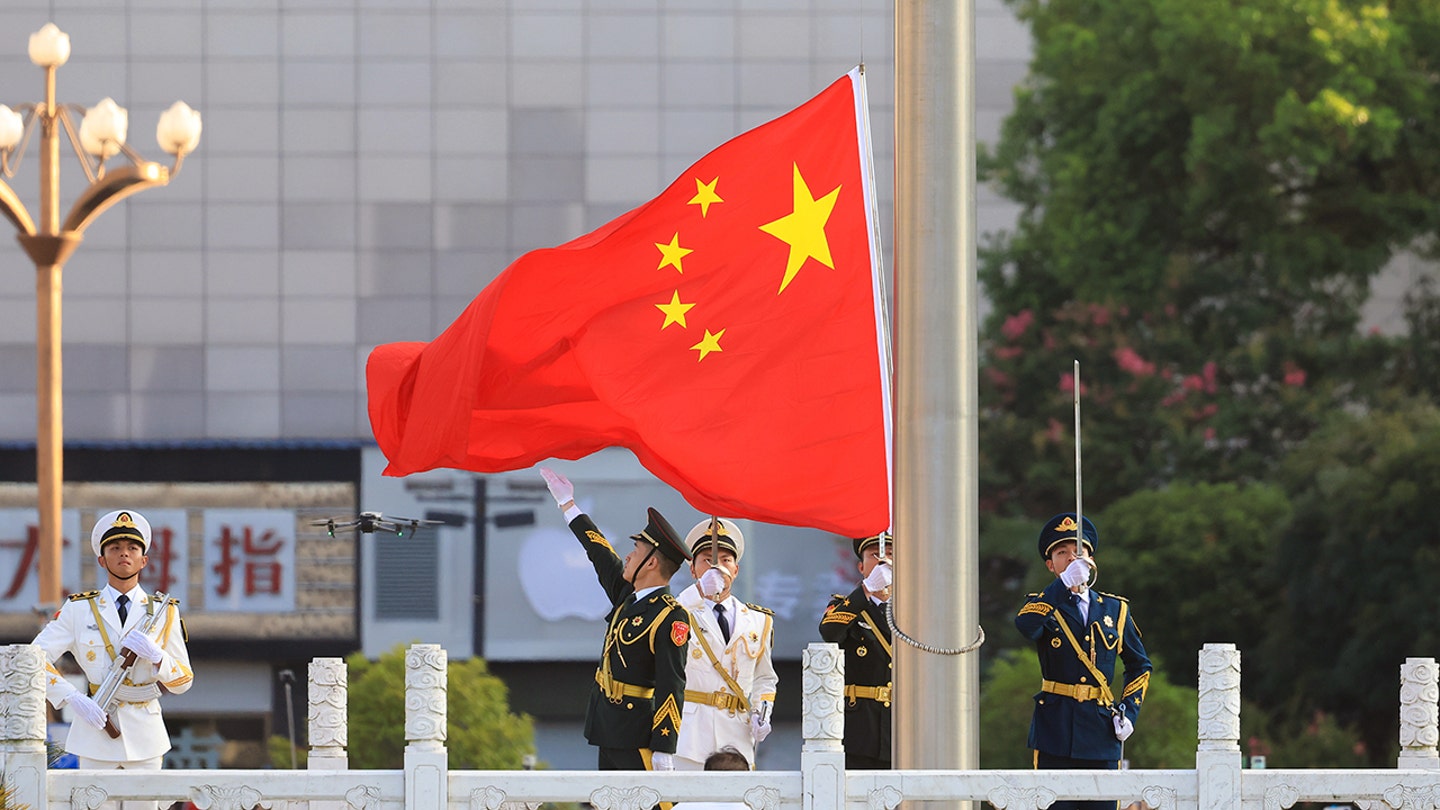

La Guardia de Honor del Ejército Popular de Liberación de China realiza una ceremonia de izamiento de bandera en la Plaza Bayi para celebrar el 97.º aniversario del Día del Ejército de China el 1 de agosto de 2024, en Nanchang. (Ma Yue/VCG vía Getty Images)

“La velocidad con la que se mueve la IA… es muy importante en el campo de batalla”, añadió. “Si la decisión que toma el sistema impulsado por IA implica quitar una vida humana, entonces quieres que sea un ser humano el que tome la decisión final sobre una decisión de ese tipo”.

Se muestra a los participantes con el Tenebris, un concepto de embarcación de superficie no tripulada de tamaño mediano, en exhibición en la cumbre de REAIM en Seúl, Corea del Sur, el 10 de septiembre de 2024. (JUNG YEON-JE/AFP vía Getty Images)

Los países líderes en el desarrollo de la IA, como Estados Unidos, han dicho que mantener un elemento humano en las decisiones serias en el campo de batalla es enormemente importante para evitar bajas por error y prevenir un conflicto impulsado por máquinas.

EL EJÉRCITO IMPULSA 2 NUEVAS ESTRATEGIAS PARA SALVAGUARDAR A LAS TROPAS BAJO EL PLAN DE IMPLEMENTACIÓN DE IA DE 500 DÍAS

La cumbre, que fue copatrocinada por los Países Bajos, Singapur, Kenia y el Reino Unido, fue la segunda de su tipo después de que más de 60 naciones asistieran a la primera reunión el año pasado celebrada en la capital holandesa.

Aún no está claro por qué China, junto con otros 30 países, optó por no aceptar los componentes básicos que buscan establecer salvaguardias para la IA, particularmente después de que Beijing respaldó un “llamado a la acción” similar durante la cumbre del año pasado.

Cuando se le presionó para que diera detalles de la cumbre durante una conferencia de prensa del miércoles, el portavoz del Ministerio de Relaciones Exteriores chino, Mao Ning, dijo que, por invitación, China envió una delegación a la cumbre donde “elaboró sobre los principios de gobernanza de la IA de China”.

Mao señaló la “Iniciativa global para la gobernanza de la IA” presentada por el presidente chino Xi Jinping en octubre y que, según ella, “ofrece una visión sistémica sobre las propuestas de gobernanza de China”.

Los participantes observan una versión en miniatura del avión de combate KF-21 en exhibición en la cumbre de REAIM en Seúl, Corea del Sur, el 10 de septiembre de 2024. (JUNG YEON-JE/AFP vía Getty Images)

El portavoz no dijo por qué China no respaldó el plan no vinculante presentado durante la cumbre de REAIM esta semana, pero agregó que “China permanecerá abierta y constructiva en el trabajo con otras partes y contribuirá de manera más tangible a la humanidad a través del desarrollo de la IA”.

HAGA CLIC AQUÍ PARA OBTENER LA APLICACIÓN FOX NEWS

Herman advirtió que, si bien naciones como Estados Unidos y sus aliados buscarán establecer acuerdos multilaterales para salvaguardar las prácticas de IA en uso militar, es poco probable que hagan mucho para disuadir a naciones adversarias como China, Rusia e Irán de desarrollar tecnologías malignas.

“Cuando se habla de proliferación nuclear o tecnología de misiles, la mejor moderación es la disuasión”, explicó el experto en IA. “Se obliga a aquellos que están decididos a seguir adelante con el uso de la IA, incluso hasta el punto de utilizarla básicamente como una especie de [a] mecanismo de muerte automática, porque ven que les conviene hacerlo; la forma en que los limitas es dejando en claro que si desarrollas armas como esas, podemos usarlas contra ti de la misma manera.

“No se cuenta con su sentido de altruismo o altos estándares éticos para frenarlos, así no es como funciona”, añadió Herman.

Reuters contribuyó a este informe.